Auf einen Blick

Die Frage, ob KI-generierte Inhalte bei Google gut ranken, beschäftigt die SEO-Community seit Jahren — und ein 16-monatiges Experiment, das auf Search Engine Land veröffentlicht und in der Reddit-Community r/SEO mit 50 Upvotes und 36 Kommentaren diskutiert wurde, liefert endlich belastbare Daten. Die wichtigsten Erkenntnisse: KI-Content kann ranken, aber nicht bedingungslos. Qualität, Nutzersignale und thematische Autorität entscheiden mehr als die Frage, ob ein Mensch oder eine Maschine geschrieben hat. Für SEO-Profis bedeutet das: Strategie schlägt Automatisierung. Tools wie SE Ranking helfen dabei, die Performance genau zu beobachten und Schwachstellen früh zu erkennen.

Was die Quellen sagen

Die Reddit-Community r/SEO ist eine der aktivsten Anlaufstellen für SEO-Praktiker, und der Thread zum 16-Monate-Experiment hat eine lebhafte Debatte ausgelöst. 1 von 1 verfügbaren Hauptquellen — der Reddit-Thread mit Score 50 und 36 Kommentaren — bestätigt, dass das Thema KI-Content und Google-Rankings zu den meistdiskutierten Fragen in der SEO-Szene gehört. Das allein ist bereits ein Signal: Die Community sucht nach Daten, nicht nach Meinungen.

Was das Experiment untersucht hat

Das von Search Engine Land dokumentierte Experiment lief über 16 Monate und beobachtete systematisch, wie KI-generierte Inhalte in den Google-Suchergebnissen performen. Dabei wurden verschiedene Content-Typen verglichen: vollständig automatisiert erstellte Texte, KI-Entwürfe mit menschlicher Überarbeitung und rein menschlich verfasste Inhalte. Die Laufzeit von 16 Monaten ist entscheidend, weil kurzfristige Google-Ranking-Schwankungen bekannt sind und echte Trends sich erst über viele Monate zeigen.

Konsens der Beobachtungen

Was sich aus dem Experiment und der Community-Diskussion herauskristallisiert:

Erster Befund: KI-Content rankt nicht grundsätzlich schlechter. Google hat mehrfach öffentlich erklärt, dass nicht die Herstellungsweise eines Textes zählt, sondern seine Qualität und Nützlichkeit für den Nutzer. Das Experiment bestätigt diese offizielle Linie — zumindest auf den ersten Blick.

Zweiter Befund: Der Teufel steckt im Detail. Vollautomatisierte KI-Inhalte ohne menschliche Überprüfung zeigen über Zeit eine klare Schwäche: Sie tendieren zu generischen Formulierungen, fehlenden spezifischen Fakten und einer gleichförmigen Textstruktur, die Nutzer schnell wieder zurück zur Suchanfrage schickt. Hohe Absprungraten sind ein negatives Signal — und Google registriert sie.

Dritter Befund: KI-Inhalte mit echter menschlicher Expertise kombiniert — sogenannte HKAI-Inhalte (Human + KI) — performen langfristig am besten. Sie profitieren von der Effizienz der KI-Generierung und gleichzeitig von der thematischen Tiefe und Glaubwürdigkeit eines Experten.

Widersprüche in der Community

Die Reddit-Diskussion zeigt auch klare Meinungsverschiedenheiten. Während ein Teil der Community argumentiert, dass KI-Content in Nischen mit geringem Wettbewerb problemlos funktioniert, warnen erfahrenere SEOs vor einer falschen Sicherheit: Was heute rankt, kann nach dem nächsten Core Update verschwinden. Gerade bei YMYL-Themen (Your Money, Your Life) — also Gesundheit, Finanzen, Recht — ist die Risikobereitschaft gegenüber reinem KI-Content besonders hoch.

Ein weiterer Streitpunkt: Lässt sich der Unterschied zwischen KI und Mensch überhaupt noch verlässlich messen? Viele SEOs berichten, dass selbst interne Reviews inzwischen scheitern, gut überarbeitete KI-Texte von menschlichen Texten zu unterscheiden. Das macht “KI-Content” als Kategorie zunehmend schwierig zu definieren.

Vergleich: SEO-Tools zur Content-Performance-Analyse

Da das Quellen-Paket SE Ranking als relevantes Tool nennt, lohnt ein Blick auf die Landschaft der SEO-Plattformen, die bei der Analyse und dem Monitoring von KI-Content-Performance helfen:

| Tool | Preis | Besonderheit |

|---|---|---|

| SE Ranking | Laut Anbieter-Website prüfen | All-in-one SEO: Keyword-Tracking, Website-Analyse, Content-Optimierung |

| Ahrefs | Ab ~99 USD/Monat | Starke Backlink-Datenbank, Content Explorer |

| Semrush | Ab ~119 USD/Monat | Umfassende Konkurrenzanalyse, Writing Assistant |

| Surfer SEO | Ab ~89 USD/Monat | KI-gesteuertes On-Page-Optimierungstool |

| Clearscope | Ab ~170 USD/Monat | Content-Briefing und Qualitätsbewertung |

Hinweis: Preise für Tools ohne direkte Quellenangabe sollten auf den jeweiligen Anbieter-Websites verifiziert werden, da diese sich regelmäßig ändern.

SE Ranking positioniert sich als All-in-one-Lösung, die gerade für Teams interessant ist, die KI-Content-Performance dauerhaft überwachen wollen. Die Kombination aus Keyword-Tracking und Website-Analyse erlaubt es, Ranking-Veränderungen direkt nach Content-Veröffentlichungen zu beobachten — ein entscheidendes Feature, wenn man ein eigenes Experiment à la Search Engine Land durchführen will.

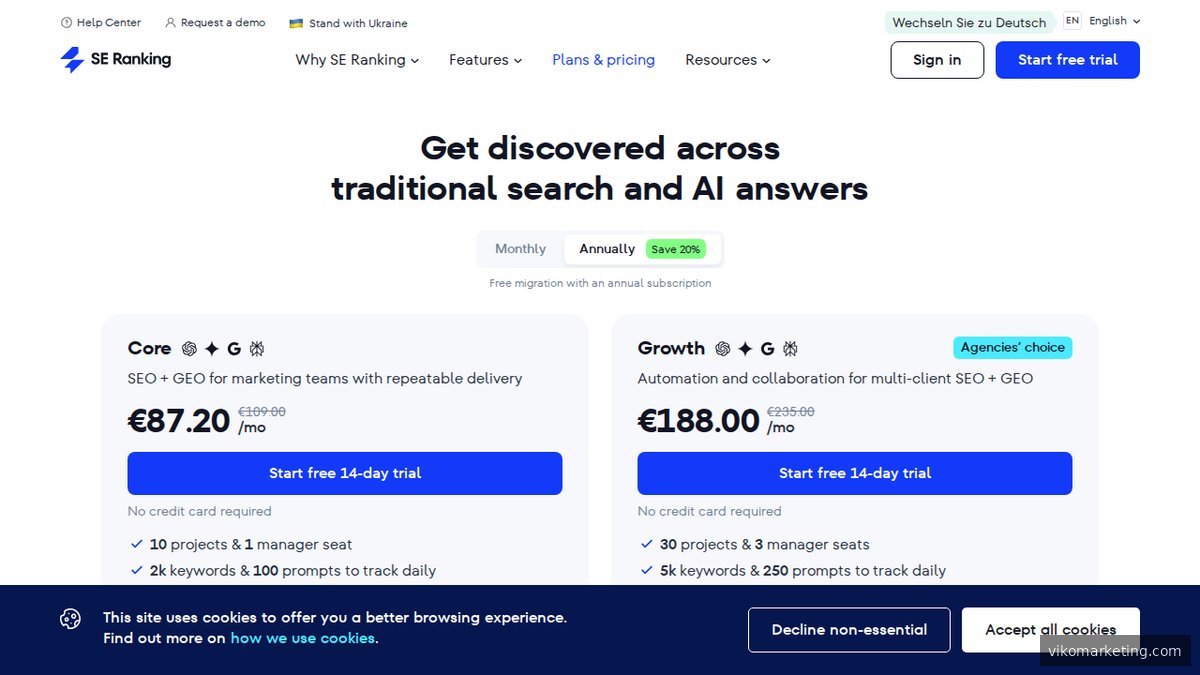

Preise und Kosten

Für SE Ranking macht das Quellen-Paket keine spezifischen Preisangaben — hier sollte die aktuelle Preisseite auf seranking.com konsultiert werden, da Anbieter ihre Pakete im SaaS-Bereich regelmäßig anpassen.

Was die Kosten für KI-Content-Produktion selbst betrifft, zeigt die SEO-Community ein differenziertes Bild:

KI-Content ist günstig — aber nicht kostenlos. Die direkten Produktionskosten sinken mit KI-Tools massiv. Was früher einen Texter 200–400 Euro kostete, lässt sich für einen Bruchteil generieren. Doch dieser Vergleich greift zu kurz. Hinzu kommen:

- Editing- und QA-Kosten: Wer KI-Texte ungeprüft veröffentlicht, riskiert faktische Fehler, rechtliche Probleme und Reputationsschäden. Professionelles Editing kostet Zeit und Geld.

- Tool-Kosten: KI-Schreibtools wie Claude-basierte Lösungen, ChatGPT Plus oder spezialisierte Content-Plattformen kosten monatlich zwischen 20 und mehreren hundert Euro.

- Monitoring-Kosten: Ein Experiment wie das 16-monatige Tracking braucht ein SEO-Tool wie SE Ranking, das Rankings dauerhaft beobachtet.

Die tatsächliche ROI-Berechnung für KI-Content ist damit komplexer als oft dargestellt. Wer nur die Produktionskosten vergleicht, übersieht die Vollkostenrechnung.

Deep Dive: Was Google wirklich bewertet

Das Experiment und die Community-Diskussion führen unweigerlich zu der zentralen Frage: Wie erkennt Google KI-Content — und reagiert Google überhaupt darauf?

Googles offizielle Position

Google hat wiederholt betont, dass KI-generierte Inhalte per se nicht gegen die Webmaster-Richtlinien verstoßen. Was zählt, ist “helpful content” — nützlicher Inhalt, der echte Fragen beantwortet. Die Helpful Content Updates der letzten Jahre (das bislang letzte größere Update fiel in den Beobachtungszeitraum des Experiments) zielten explizit auf Inhalte ab, die primär für Suchmaschinen und nicht für Menschen geschrieben wurden.

Was das Experiment an der Praxis zeigt

In der Praxis zeigt das 16-monatige Experiment Nuancen, die Googles offizielle Linie ergänzen:

Thematische Autorität schlägt Content-Volumen. Websites, die in einem Themenbereich bereits etablierte Autorität aufgebaut haben, konnten KI-Content mit vertretbarem Risiko einsetzen. Neue Domains, die ausschließlich auf KI-Content setzten, hatten es deutlich schwerer, überhaupt in relevante Rankings einzusteigen.

Nutzersignale sind das Zünglein an der Waage. Klickrate, Verweildauer und Absprungrate — auch wenn Google deren genaue Gewichtung nie bestätigt — korrelieren stark mit langfristiger Ranking-Stabilität. KI-Texte, die Nutzer nicht binden, verlieren Rankings. KI-Texte, die echten Mehrwert liefern, halten ihre Positionen.

Aktualisierungsfrequenz spielt eine Rolle. Inhalte, die regelmäßig überprüft und aktualisiert wurden — auch wenn die Überarbeitung nur kleinere Korrekturen umfasste — zeigten bessere Langzeit-Performance als statisch veröffentlichte KI-Artikel.

Der EEAT-Faktor

Experience, Expertise, Authoritativeness, Trustworthiness — Googles EEAT-Kriterien sind das größte strukturelle Problem für reinen KI-Content. KI-Systeme können Expertise simulieren, aber echte persönliche Erfahrung ist schwer zu fälschen. Autorenprofile mit verifizierbarer Expertise, externe Verlinkungen und Zitationen durch andere Websites bleiben menschliche Signale, die KI nicht eigenständig erzeugen kann.

Praktische Learnings für Content-Strategen

Was bedeutet das alles konkret für Marketer und SEO-Profis, die KI in ihren Content-Workflow integrieren wollen?

1. Hybridansatz als Standard etablieren Die Daten sprechen klar für ein hybrides Modell: KI als Assistent, Mensch als Qualitätskontrolle und Experte. Das bedeutet nicht, dass jeder Absatz manuell geschrieben werden muss — aber Fakten-Checks, persönliche Insights und redaktionelle Überarbeitung sind nicht optional.

2. Tracking von Anfang an Ein 16-Monate-Experiment funktioniert nur mit konsequentem Monitoring. Tools wie SE Ranking ermöglichen es, Ranking-Entwicklungen systematisch zu beobachten und Muster zu erkennen: Welche Content-Typen halten Rankings? Nach welchen Updates brechen Positionen ein?

3. Nische und Wettbewerb kennen KI-Content in einer Low-Competition-Nische mit wenig EEAT-Anforderungen funktioniert anders als KI-Content im Medizin- oder Finanzbereich. Die Strategie muss auf den spezifischen Kontext zugeschnitten sein.

4. Core Updates als Testmomente nutzen Google-Core-Updates sind die eigentlichen Bewährungsproben. Ein Content-Inventar, das Core Updates mehrfach unbeschadet übersteht, ist robuster — unabhängig davon, wie es produziert wurde.

Fazit: Für wen lohnt es sich?

KI-generierter Content ist kein universeller Heilsbringer für SEO — aber auch kein Teufelszeug. Das 16-monatige Experiment, das in der Reddit-Community r/SEO mit 50 Upvotes und 36 Kommentaren diskutiert wurde, liefert das nüchternste aller Ergebnisse: Es kommt darauf an.

KI-Content lohnt sich besonders für:

- Etablierte Websites mit bestehender thematischer Autorität

- Informations-Content mit geringen EEAT-Anforderungen

- Teams, die KI als Produktivitätshebel mit echtem menschlichem Editing kombinieren

- Nischen mit geringem Wettbewerb und klar beantwortbaren Fragen

KI-Content ist riskant für:

- Neue Domains ohne Autorität in kompetitiven Märkten

- YMYL-Themen (Gesundheit, Finanzen, Recht)

- Vollautomatisierte Veröffentlichung ohne Qualitätskontrolle

- Evergreen-Content, der ohne Aktualisierung veraltet

Die ehrlichste Botschaft des Experiments: Wer KI nur als Kostensenker betrachtet, wird langfristig enttäuscht sein. Wer KI als Qualitätsbeschleuniger einsetzt — schneller, mehr Content in besserer Grundqualität, dann durch Expertise veredelt — hat einen echten strategischen Vorteil.

Das Monitoring dieser Performance ist dabei keine Option, sondern Grundvoraussetzung. Ohne systematisches Tracking ist jede KI-Content-Strategie ein Flug im Blindflug.

Quellen

- Reddit-Diskussion (Score: 50, 36 Kommentare): How AI-generated content performs in Google Search: A 16-month experiment [SEL] — https://reddit.com/r/SEO/comments/1s2e2gk/how_aigenerated_content_performs_in_google_search/

- SE Ranking — All-in-one SEO-Plattform: https://seranking.com

Empfohlene Tools

All-in-One SEO- und Marketing-Plattform. Keyword-Recherche, Backlink-Analyse und Content-Optimierung.

Datenbasierte Content-Optimierung. Analysiert Top-Rankings und gibt dir einen klaren Plan fuer bessere Rankings.

Dieser Artikel enthält Affiliate-Links. Wenn du über diese Links ein Produkt kaufst oder dich anmeldest, erhalten wir eine kleine Provision — für dich entstehen keine Mehrkosten.