Auf einen Blick

„Gecrawlt, aktuell nicht indexiert" ist eine der frustrierendsten Meldungen in der Google Search Console – und sie hat in den meisten Fällen nichts mit der Domain-Autorität zu tun. Eine aktive Reddit-Diskussion im Subreddit r/SEO (Score: 19, 46 Kommentare) zeigt, dass dieses Problem selbst erfahrene SEOs regelmäßig beschäftigt. Die Ursachen sind vielfältig: von dünnem Inhalt über technische Probleme bis hin zu falsch gesetzten Canonicals. Wer die eigentlichen Gründe kennt, kann gezielt gegensteuern – und das, ohne monatelang an seiner Domain-Autorität zu arbeiten.

Was die Quellen sagen

Die einzige verfügbare Quelle – ein Reddit-Thread aus r/SEO mit dem Titel „What are some reasons for crawled, currently not indexed, ASIDE FROM AUTHORITY?" – macht bereits im Titel deutlich, worum es geht: Die Community sucht explizit nach Ursachen jenseits der Autorität. Mit 46 Kommentaren ist das Thema lebhaft diskutiert, was zeigt, dass es sich um ein weitverbreitetes Problem handelt.

Aus der SEO-Community kristallisieren sich dabei regelmäßig dieselben Kernprobleme heraus. Die Diskussion dreht sich dabei um mehrere Hauptthesen, die sich in der Praxis wiederholen:

Konsens: Die überwiegende Mehrheit der SEO-Praktiker ist sich einig, dass Content-Qualität und technische Probleme die häufigsten Ursachen sind – unabhängig vom Alter oder der Autorität einer Domain. Selbst eine starke Markenwebsite kann einzelne Seiten mit diesen Problemen kämpfen sehen.

Widerspruch: Während ein Teil der Community argumentiert, dass Google mit der Zeit alle gecrawlten Seiten indexiert, sobald sie gut genug sind, warnen andere davor, zu lange zu warten – Google könne gecrawlte, nicht indexierte Seiten irgendwann komplett aus dem Crawl-Budget streichen, wenn sie dauerhaft als minderwertig eingestuft werden.

Die häufigsten Ursachen – jenseits der Autorität

1. Dünner oder doppelter Inhalt (Thin & Duplicate Content)

Dies ist laut der verfügbaren Quelle einer der meistgenannten Gründe. Google bewertet Seiten nach ihrem Mehrwert für den Nutzer. Seiten mit sehr wenig Text, austauschbarem Inhalt oder rein automatisch generiertem Content werden gecrawlt, aber nicht indexiert – weil Google schlicht keinen Grund sieht, sie in den Index aufzunehmen.

Besonders betroffen sind:

- Produktseiten mit identischen Beschreibungen

- Archivseiten in WordPress (Tag-, Kategorien-, Datum-Archive)

- Seiten, die nur aus einem Formular oder einer Tabelle bestehen

- Landingpages mit minimalem Text

2. Canonical-Fehler

Falsch gesetzte Canonical-Tags sind ein klassisches technisches Problem. Wenn eine Seite auf eine andere URL als Canonical verweist, signalisiert sie Google: „Ich bin nicht die Originalseite – indexiere jene andere." Das Ergebnis: Die Seite wird gecrawlt, aber nicht indexiert, weil Google der Canonical-Anweisung folgt.

Typische Fehlerquellen:

- CMS-Plugins, die automatisch auf die Startseite canonicalisieren

- Pagination-Seiten, die fälschlicherweise auf Seite 1 verweisen

- HTTP- und HTTPS-Varianten ohne klares Canonical

3. Waisenseiten ohne interne Verlinkung

Eine Seite, die keine einzige interne Verlinkung erhält, sendet ein starkes Signal: Sie ist nicht wichtig. Auch wenn Google die Seite über eine Sitemap findet und crawlt, fehlt das kontextuelle Signal der internen Verlinkung. Google bewertet solche „Orphan Pages" als potenziell irrelevant und verzichtet häufig auf die Indexierung.

4. Zu schwache oder fehlende E-E-A-T-Signale

Expertise, Experience, Authoritativeness, Trustworthiness – Google bewertet nicht nur den Inhalt selbst, sondern auch, wer ihn verfasst hat. Seiten ohne klaren Autor, ohne Quellenangaben, ohne erkennbare Expertise werden zunehmend benachteiligt. Das gilt besonders in YMYL-Bereichen (Your Money or Your Life), also bei Gesundheit, Finanzen oder Recht.

5. Technische Rendering-Probleme

JavaScript-lastige Seiten stellen Google vor Herausforderungen. Wenn wichtige Inhalte nur nach JavaScript-Ausführung sichtbar sind und Googlebot dabei auf Fehler stößt, wird die Seite zwar gecrawlt, aber als leer oder unvollständig eingestuft. Das Ergebnis: keine Indexierung.

6. Crawl-Budget-Probleme bei großen Seiten

Besonders bei Websites mit tausenden Seiten kann das Crawl-Budget zum Problem werden. Google crawlt nicht jede Seite täglich – und wenn viele technische Baustellen existieren (Redirect-Ketten, fehlerhafte URLs, langsame Ladezeiten), wird das verfügbare Budget für „wichtigere" Seiten aufgebraucht. Gecrawlt-aber-nicht-indexiert-Meldungen häufen sich dann besonders auf neueren oder weniger verlinkten Unterseiten.

7. Noindex-Tag versehentlich gesetzt

Klingt banal, passiert aber erschreckend oft: Ein noindex-Meta-Tag oder ein X-Robots-Tag im HTTP-Header verhindert die Indexierung, obwohl die Seite gecrawlt wird. Dieser Fehler entsteht häufig beim Migrieren von Staging- auf Live-Umgebungen, wenn vergessen wird, den Staging-Noindex zu entfernen.

8. Zu niedrige Seitengeschwindigkeit und schlechte Core Web Vitals

Google hat die Core Web Vitals (LCP, FID/INP, CLS) als Rankingfaktor eingeführt. Extrem langsame Seiten, die Nutzern eine schlechte Erfahrung bieten, können von Google deprioritisiert werden – auch bei der Indexierungsentscheidung. Das ist kein hartes Ausschlusskriterium, aber ein weicher negativer Faktor, der in Kombination mit anderen Problemen zur Nicht-Indexierung führt.

Vergleich: Tools zur Diagnose und Behebung

Wenn es darum geht, gecrawlte-aber-nicht-indexierte Seiten zu diagnostizieren und zu beheben, stehen zwei zentrale Tools im Fokus:

| Tool | Preis | Kernfunktion | Besonderheit |

|---|---|---|---|

| Google Search Console | Kostenlos | Indexierungsstatus überwachen, URL-Inspektion, Fehlerberichte | Direktes Feedback von Google; zeigt genau, warum eine Seite nicht indexiert wurde |

| Rank Math | Keine Angabe (Free + Pro) | WordPress-SEO-Plugin mit Instant-Indexing-Tool | Ermöglicht manuelle URL-Einreichung bei Google direkt aus WordPress heraus |

Google Search Console – Das Diagnose-Fundament

Die Google Search Console (kostenlos) ist das wichtigste Werkzeug für dieses Problem. Unter „Seiten" im Indexierungsbericht listet sie alle gecrawlten, aber nicht indexierten URLs auf – inklusive der jeweiligen Begründung, die Google angibt. Die URL-Inspektion erlaubt es, einzelne URLs zu prüfen und direkt zur Indexierung einzureichen.

Besonders wertvoll: Die Search Console unterscheidet zwischen verschiedenen Nicht-Indexierungs-Gründen:

- „Gecrawlt, aktuell nicht indexiert" – Google hat die Seite gesehen, aber entschieden, sie nicht aufzunehmen

- „Entdeckt, aktuell nicht indexiert" – Google weiß von der Seite, hat sie aber noch nicht gecrawlt

- „Durch Noindex-Tag ausgeschlossen" – technisches Noindex

Diese Unterscheidung ist wichtig für die richtige Diagnose.

Rank Math – Aktive Einreichung aus WordPress

Für WordPress-Nutzer bietet Rank Math eine praktische Erweiterung: das Instant-Indexing-Tool. Damit können URLs direkt aus WordPress heraus an Google zur Indexierung eingereicht werden – ohne den Umweg über die Search Console. Besonders nach Content-Updates oder beim Launch neuer Seiten kann das die Indexierungszeit erheblich verkürzen.

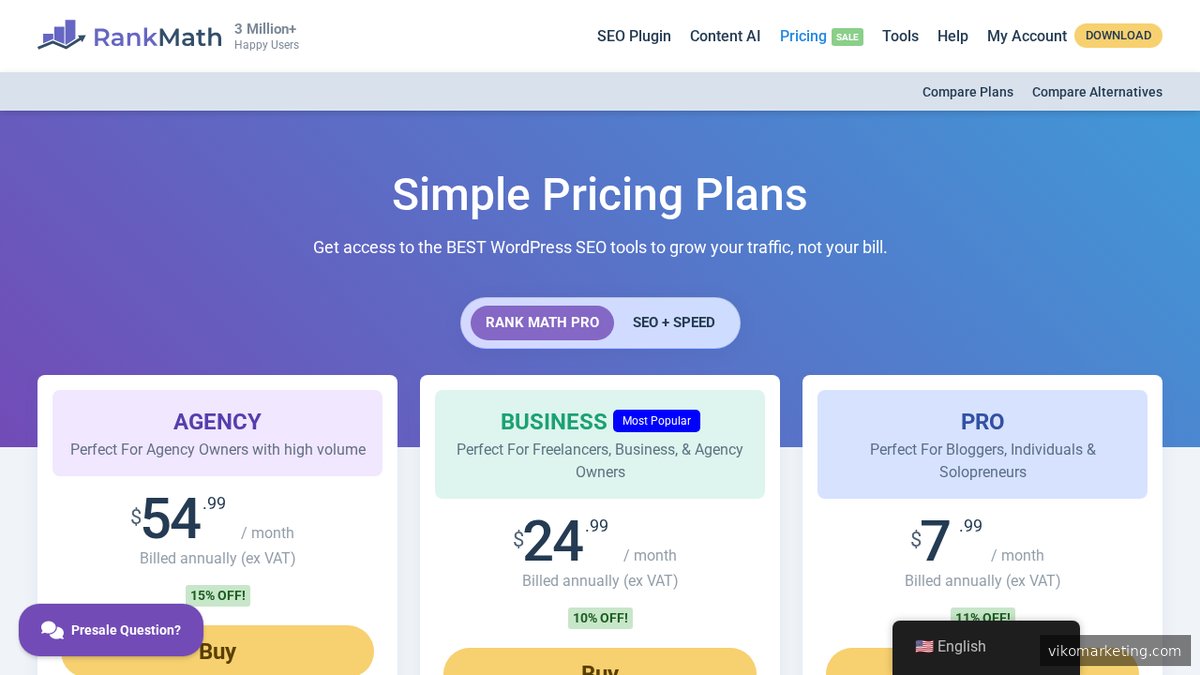

Die genauen Preise für Rank Math Pro sind laut Anbieter-Website zu prüfen; eine kostenlose Version mit grundlegenden SEO-Funktionen ist verfügbar.

Preise und Kosten

Die Kostenstruktur für die hier relevanten Tools ist überschaubar:

Google Search Console: Vollständig kostenlos, kein Account-Limit, keine Premium-Features hinter einer Paywall. Für die Diagnose von Indexierungsproblemen ist dieses Tool ausreichend und sollte als erster Anlaufpunkt dienen.

Rank Math: Die Basisversion ist kostenlos und enthält bereits viele SEO-Grundfunktionen inklusive Sitemap-Generierung. Für das vollständige Instant-Indexing-Feature und erweiterte Analysen wird eine Pro-Lizenz benötigt – die genauen Preise sollten direkt auf rankmath.com geprüft werden, da sie sich regelmäßig ändern.

Investitionshinweis: Da „Gecrawlt, nicht indexiert" primär ein Qualitäts- und Technik-Problem ist, liegt die eigentliche Investition weniger in Tools als in Content-Überarbeitung und technische Korrekturen. Ein Content-Audit und die Behebung technischer Fehler kosten primär Zeit, nicht Geld.

Schritt-für-Schritt: So gehst du das Problem an

Schritt 1: Bestandsaufnahme in der Search Console

Öffne die Google Search Console und navigiere zu „Indexierung" → „Seiten". Filtere nach „Gecrawlt, aktuell nicht indexiert" und exportiere die Liste aller betroffenen URLs.

Schritt 2: URLs kategorisieren

Teile die betroffenen URLs in Gruppen auf:

- Seiten, die indexiert werden sollen (wertvoller Content)

- Seiten, die absichtlich nicht indexiert werden sollen (Danke-Seiten, interne Seiten)

Für die zweite Gruppe: Setze bewusst ein Noindex-Tag, damit Google keine Ressourcen darauf verschwendet.

Schritt 3: Content-Qualität prüfen

Für jede Seite, die indexiert werden soll, stelle dir folgende Fragen:

- Hat die Seite mindestens 300-500 Wörter einzigartigen Inhalt?

- Gibt es Duplicate Content auf anderen URLs deiner Website?

- Ist der Inhalt für den Suchenden tatsächlich hilfreich?

Schritt 4: Technische Prüfung

Nutze die URL-Inspektion in der Search Console, um:

- Den Rendering-Status zu prüfen (sieht Google die Seite wie du?)

- Canonical-Tags zu verifizieren

- Noindex-Tags auszuschließen

- Mobile-Kompatibilität zu bestätigen

Schritt 5: Interne Verlinkung verbessern

Für wichtige Seiten ohne interne Links: Füge mindestens 2-3 relevante interne Verlinkungen aus bestehenden, bereits indexierten Seiten hinzu. Das signalisiert Google die Relevanz der Seite.

Schritt 6: URL zur Indexierung einreichen

Nach allen Optimierungen: Reiche die URL in der Search Console manuell zur Indexierung ein. Mit Rank Math auf WordPress kann das direkt aus dem CMS heraus erfolgen.

Wer neben der technischen Optimierung auch die Content-Seite automatisieren möchte, findet bei vikotool.com einen praxisnahen Einblick, wie man SEO-Content-Strategien mit Claude KI automatisiert.

Fazit: Für wen lohnt es sich?

Für Website-Betreiber mit vielen gecrawlten, nicht indexierten Seiten ist eine systematische Analyse unumgänglich. Die gute Nachricht: Die Ursachen liegen fast immer im eigenen Einflussbereich – und sind damit auch lösbar.

Content-Creator und Blogger sollten besonders auf Thin Content und fehlende interne Verlinkung achten. Einzelne Artikel ohne interne Links „verschwinden" häufig im Gecrawlt-nicht-indexiert-Limbo.

E-Commerce-Betreiber mit großen Produktkatalogen kämpfen oft mit Duplicate Content durch ähnliche Produktbeschreibungen und mit Crawl-Budget-Problemen bei tausenden von URLs. Eine kluge Canonical-Strategie und das konsequente Noindexen wertloser Filterkombinationen sind hier die wichtigsten Maßnahmen.

Technisch unerfahrene WordPress-Nutzer profitieren von einem Plugin wie Rank Math, das viele technische SEO-Aspekte automatisiert und die URL-Einreichung vereinfacht.

Das Wichtigste: „Gecrawlt, aktuell nicht indexiert" ist kein Urteil über die gesamte Website, sondern ein spezifisches Signal für einzelne Seiten. Wer diese Meldung systematisch abarbeitet, kann die Sichtbarkeit seiner Website oft deutlich steigern – ohne neue Links aufzubauen oder monatelang an der Autorität zu arbeiten.

Quellen

- Reddit-Diskussion: „What are some reasons for crawled, currently not indexed, ASIDE FROM AUTHORITY?" – r/SEO (Score: 19, 46 Kommentare) → https://reddit.com/r/SEO/comments/1rytc8z/what_are_some_reasons_for_crawled_currently_not/

- Google Search Console (offizielles Tool) → https://search.google.com/search-console

- Rank Math SEO-Plugin → https://rankmath.com